Рассказываем как настроить парсеры Site-analyzer и Screaming Frog SEO Spider. Этот материал является дочерним для двух наших материалов:

- поиск конкретного элемента HTML на сайте: теория и практика;

- Как найти слово на сайте и какие инструменты для этого есть.

Пару слов о парсерах

Обзорная информация об инструментах, которые будем настраивать со ссылками на документацию.

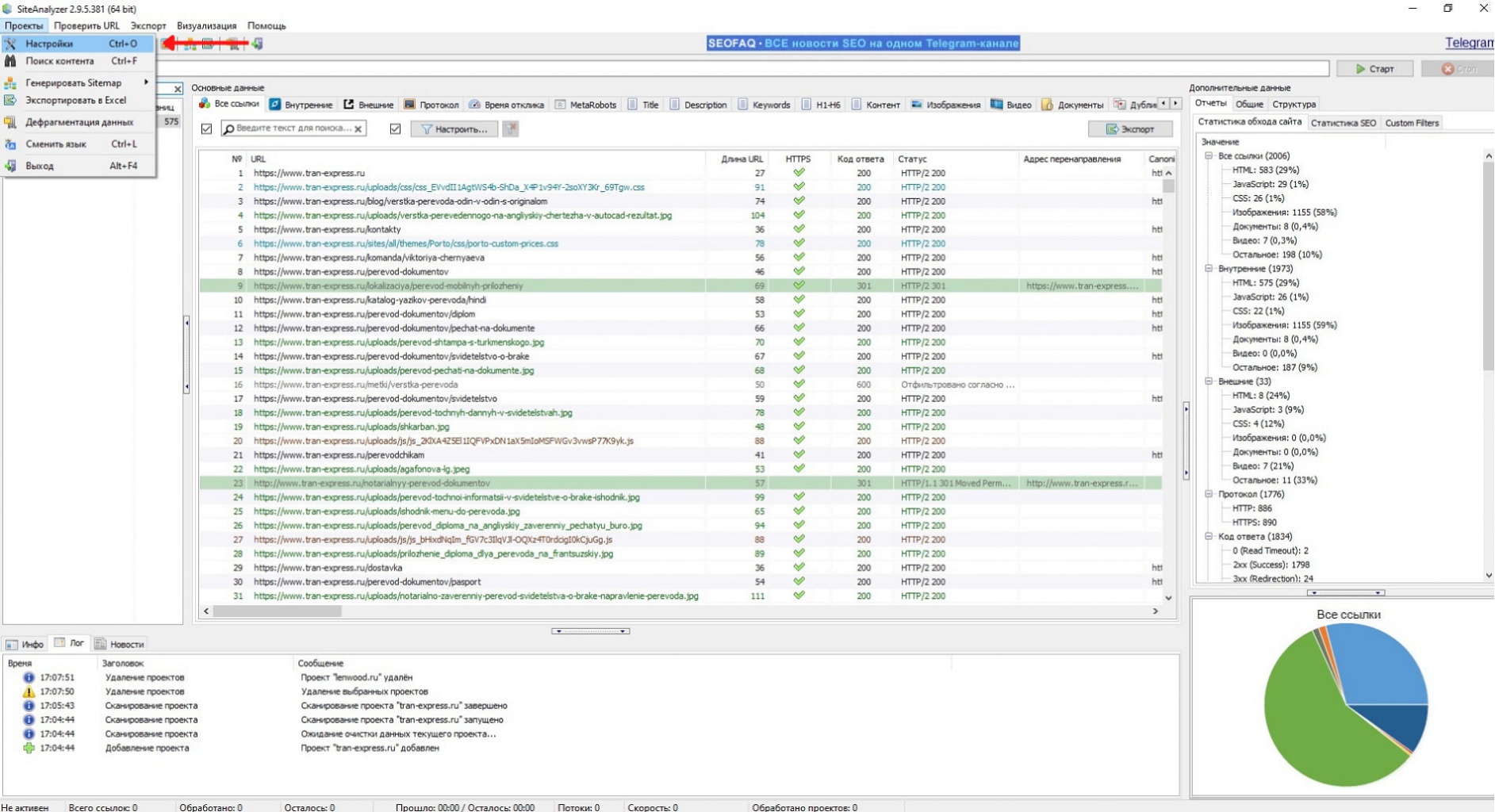

SiteAnalyzer

Программа SiteAnalyzer это веб-краулер, позволяющий быстро и эффективно проводить технический аудит сайтов, находить и исправлять ошибки SEO-оптимизации - так о себе пишет парсер на своем сайте.

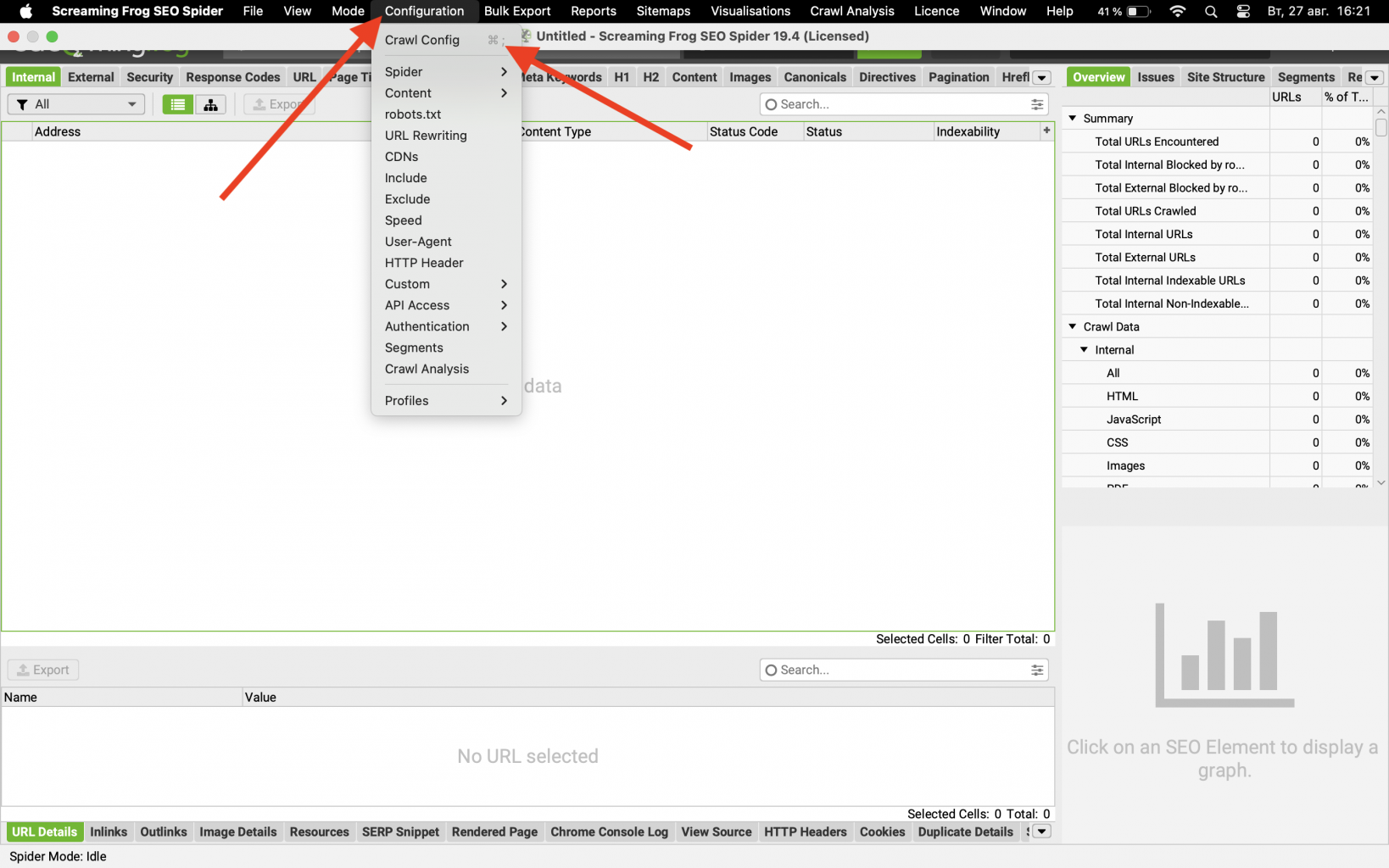

Screaming Frog SEO Spider

Оригинальными не будем и описание для данного парсера также возьмем с официального сайта: SEO Spider — это мощный и гибкий инструмент для сканирования сайтов, способный эффективно обходить как небольшие, так и очень крупные веб-ресурсы, с возможностью анализа результатов в режиме реального времени. Он собирает ключевые данные о сайте, позволяя SEO-специалистам принимать обоснованные решения.

От себя добавим, что оба инструмента полезны и нами использовались в разные периоды. На данный момент мы почти полностью перешли на "лягушку", отчасти потому что, Site-Analyzer нет на macOS, разумеется, можно запустить через программы, запускающие программы, написанные для Windows на macOS, например CrossOver. Для данной статьи мы так и сделали, пользоваться можно, но есть недостатки в адаптации: артефакты в интерфейсе и задержки в работе.

На большинстве сайтов стоит защита от парсинга, чтобы не перегружать сервер. При попытке спарсить программа не будет отображать информацию и наполнится ошибками по каждому урлу. Обход защиты для каждого сайта свой, но наиболее популярными способами являются:

1. Смена User-Agent

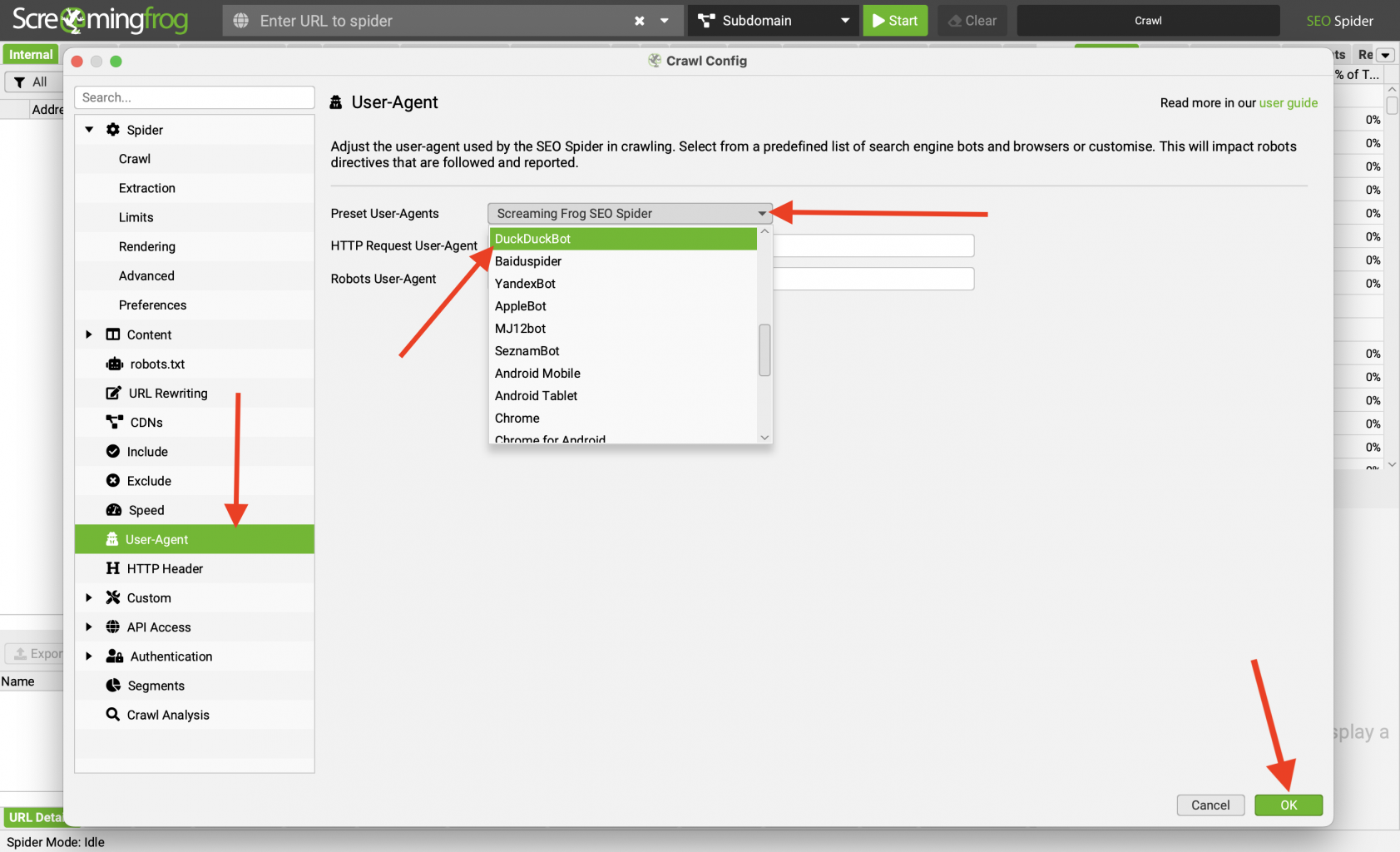

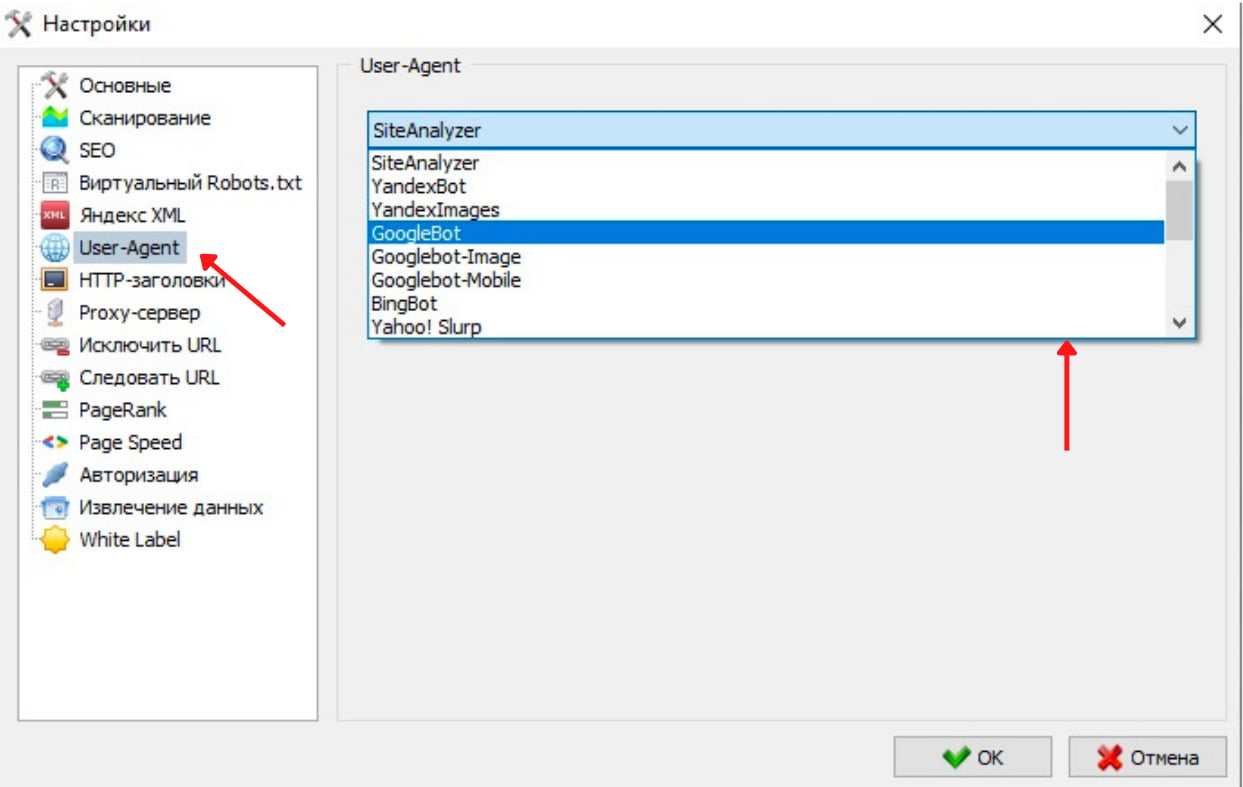

Начнем с базовой настройки, которую мы рекомендуем делать вначале любого парсинга - смену юзер агента. User-Agent - это строка, которую браузер, а в нашем случае парсер, отправляет на сервер при запросе веб-страниц. Она содержит информацию об операционной системе, браузере и другие данные, подробная информация о User-Agent в документации MDN.

Список User-Agent может отличаться в зависимости от парсера. Например, на момент написания данной статьи в Screaming Frog SEO Spider было доступно более 30 агентов, а в Site-Analyzer только 17.

В свое время DuckDuckBot для нас стал "мастхэвом" для беспроблемного парсинга сайтов, избавив от большинства других манипуляций в настройках. Успешно парсит без каких-то помех все сайты, которые мы ему скармливали, но не доступен в Site-Analyzer.

В большинстве случаев, смена агента решает все проблемы, но если это не ваш случай, переходите к следующему этапу.

2. Настройка скорости парсинга

Скорость парсинга — это параметр, который определяет, с какой скоростью парсер обходит и загружает страницы сайта. В большинстве парсеры имеют следующие настройки:

- Max URL/s (максимум URL в секунду) — ограничивает, сколько URL можно запрашивать в секунду.

- Max Threads (максимум потоков) — определяет, сколько одновременно работает потоков. Говоря проще, сколько страниц парсится параллельно.

Чем выше эти значения — тем быстрее работает парсинг. Но слишком высокая скорость может перегрузить сервер сайта, что вызовет ошибки или даже временную блокировку.

Далее необходимо подобрать оптимальные параметры (чтобы понравиться серверу и не ждать окончание парсинга неделю).

В рассматриваемых нами парсерах интерфейс отличается, поэтому детально рассмотрим в каждом из них.

В данном случае, мы не можем точно сказать какие из параметров сработают у вас. На нашей практике одни сайты хорошо парсились и при стандартных настройках, а для других требовалась тонкая настройка параметров.

3. Следовать или нет robots.txt

Файл robots.txt содержит инструкции для поисковых роботов, указывая, какие страницы сайта им разрешено или запрещено сканировать. С его помощью можно управлять доступом к отдельным разделам и уменьшать количество запросов, снижая нагрузку на сервер. Подробное пояснение о файле robots можно почитать в документации Google.

В материале мы показали несколько способов настройки Screaming Frog и Site-Analyzer, которые используем при парсинге сами. Если вы знаете другие способы - пишите в комментариях, будем рады протестировать и дополнить материал.